AIと人事・働き方

働く側はどう向き合うかAIの技術的特徴を学び

労働組合としての対応を

AIが「Society 5.0」の中核に

歴史と発展をおさらい

政府は、新しい社会の姿として「Society 5.0」を提唱しています。サイバー空間とフィジカル空間を融合させ、経済の発展と社会課題の解決を両立させる姿を描いています。私たちは、そうした来るべき社会の仕組みを研究ターゲットにしています。

最初にAIの歴史と今後への期待について簡単に説明します。

人工知能(AI)の開発は、1950年代後半から進められており、現在は第3次AIブームだといわれています。第3次ブームの火付け役は、機械学習の一つである深層学習(ディープラーニング)の研究の進展だったといわれています。

その背景には大きく三つの技術的な進化がありました。

一つ目は、深層学習の登場です。これにより画像や音声認識の性能が飛躍的に向上しました。

二つ目は、ビッグデータの活用です。クラウドやIoTの進化によって、さまざまな機器から膨大な情報が1カ所に集められるようになりました。

三つ目は、計算能力の向上です。もともと画像処理に特化した演算装置であるGPUを画像処理以外の用途に使う技術が進展し、深層学習に必要な膨大な並列高速演算を実用的な速度で実施可能になりました。

深層学習は、ニューラルネットワークという人間の脳の神経細胞をまねた情報処理の仕組みになっています。大量の学習用データを用意し、ニューラルネットワークに入力データと正解データを与えると、AIは正解の結果を出力するようにその特徴を自動的に計算します。

深層学習の強みは、入力されたデータを強力に分類・識別できることです。一方、弱みは、深層学習では分類や識別の根拠がわからないことです。ニューラルネットワークの内部は分析できないので、AIがなぜその答えを返してきたのかがわかりません。また、必ずしも期待される効果が得られるわけではないこと、使いこなすためには一定のノウハウが必要になることも知っておく必要があります。

AIは、「Society 5.0」の中核となる技術といって過言ではありません。フィジカル空間のデータをサイバー空間に持ち込み、それを分析・処理して現実世界にフィードバックする際にAIが欠かせません。

一方で、AIを利活用するためには、倫理や制度、社会の受容性などにかかわる課題に向き合う必要があります。これらの課題の解決に向けて今後も研究を続けていきます。

AIの労働分野への導入と

法的問題点とは?

AIの労働分野への導入

私たちはAI技術の労働分野への応用時に次のような法的な問題があると考え、研究を始めました。

一つは、自分の提供したデータを用いたAIが、自分の仕事を奪ったらどうするのかという問題。もう一つは、AIの開発者と使用者のどちらに責任があるのかという問題です。こうした問題について、AIの技術的特徴などを踏まえながら説明していきたいと思います。

次に、労働分野でのAIの導入状況を紹介します。AIは、書類選考や面接のフェーズなどですでに導入されています。また、AIを画像診断に用いて病気の早期発見や見落とし防止に役立てようとするケースもあります。

少子高齢化や労働力人口の減少を踏まえると、稼働の削減やベテラン技術者の技能情報を伝承する意味でも、AIの導入は必然的であると考えられます。

透明性や責任の所在

次にAIの問題点を見ていきます。一つ目は、採用や人事考課における差別や透明性に関する問題です。例えば、米国アマゾンでは、自社データを用いて採用AIを開発しようとしたところ、学習データに偏りがあり、AIが女性を低く評価することがわかり、テスト段階で開発を中止した事例がありました。

また、日本IBMでは、労働組合がAIを用いた人事評価や賃金決定に関して団体交渉を求め、労働委員会に救済を申し立てています。労働組合は、AIの透明性にかかわることとして、(1)学習させるデータの内容、(2)賃金決定を判断する所属長に対してAIが提示する内容、(3)最終的な判断は人間の評価者が行っているのかどうかを開示し、説明することを求めています。

二つ目に、AIの利用によって問題が生じたときに、プログラムの開発者、その使用者のどちらが責任を負うのかという問題があります。例えば、自動運転の車が事故を起こした際に、その責任は開発者が負うのか、使用者が負うのかという問題です。とりわけ、人間とAIの判断が対立した場合はどうするのかなど、引き続き検討が必要です。

AIの技術的特徴とは?

次に、AIを労働分野に導入する際、何に注意すべきなのか、その技術的特徴を踏まえながら確認していきます。

AIは、主に「汎用型」と「特化型」の二つに分類されます。前者は幅広い対象に対して推論(分析・予測)できる性能を持つもの。後者は、特定の分野・領域のみを対象に推論するものです。

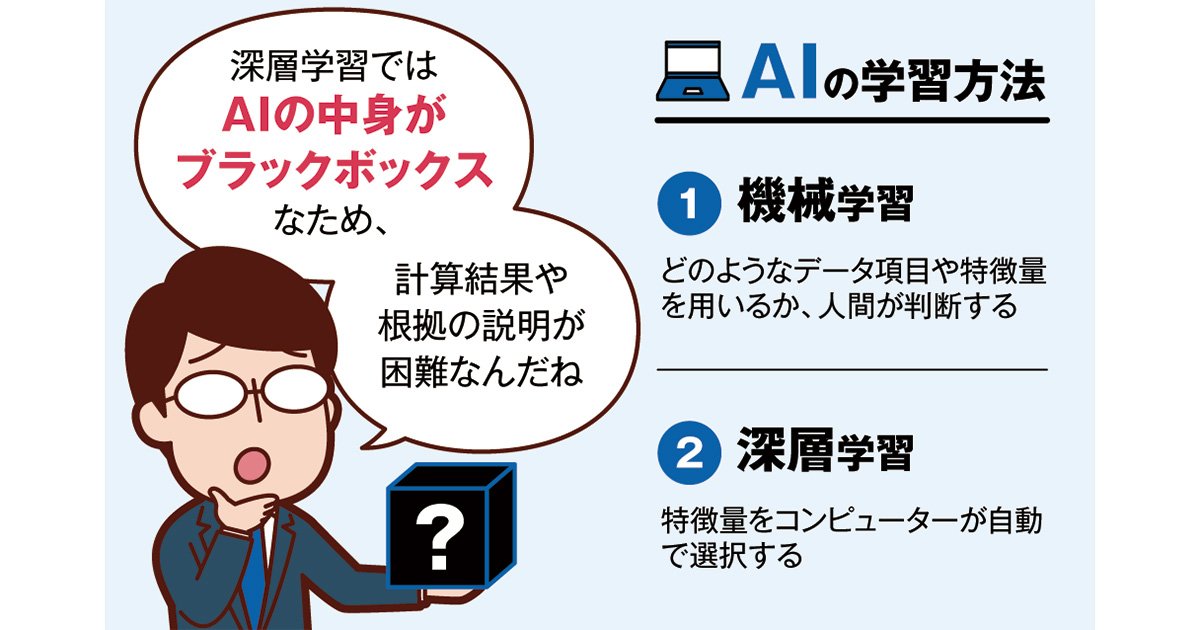

現在のAIには主に機械学習(深層学習を含む)が用いられています。機械学習は、データに潜むパターンやルールをコンピューターが自動で学習し、その学習に基づいて、新たなデータが入力された際に推論結果を返す仕組みです。どのようなデータ項目を用いるのか、その項目にどの程度の重みを持たせるのかは人間が指定します。そのため人間が適切な特徴量(着目するデータ項目)を選択することがポイントになります。

機械学習を発展させた深層学習は、特徴量もコンピューターが自動で選択します。計算過程は複雑で人間が理解するのは困難です。

機械学習を用いたAIの作成は、「学習段階」と「推論段階」に分かれます。まず、作成段階として、過去のデータを学習し、モデルを作成するのが「学習段階」です。例えば、過去のエントリーシートや社員の勤怠データを集めて学習データを作成します。学習させるデータを集めたら、人間がそれにラベルや重みをつけて、学習済みモデルを作成します。

その上で、できあがった学習済みモデルに分析対象データを与えて推論させるのが「推論段階」です。この段階でも、どのようなデータを分析するのかを選ぶのは人間です。このように機械学習では人間の関与があるのが特徴です。

機械学習には次のようなメリット・デメリットがあります。

メリットは、大量のデータを短時間で処理でき、人間が気付かないようなパターンやルールを発見できる可能性があることです。また、分析手順のミスがないので、結果がぶれないというメリットがあります。

一方でデメリットは実用に耐えるような高精度のシステムを作ろうとすればコストがかかるということです。データの前処理や見直しに労力がかかる上、機械学習のほか、業務分野の知識も必要です。

また、注意点として、機械学習では、用いるデータや特徴量の選択によって人間のバイアスが少なからず入り込むため、公平性は必ずしも保証されません。深層学習では、コンピューターが特徴量をどう選択したのかもわかりません。

注意点の二つ目は、AIは過去のデータに基づいて判定するため、外れ値や新しいパターンを適切に判定できません。例えば、新しい業種のための新しいスキルを持つ人材を発見するようなケースにはうまく使えません。

三つ目は、深層学習では計算結果や根拠の説明が困難であるということです。

公平性や差別が課題に

AIの特徴を踏まえて、労働分野とAIのかかわりをみていきましょう。

採用・人事考課の事例では、AIは、労働者の採用から退職まで、さまざまな場面で用いることが可能です。具体的には、採用の書類選考、面接、配置の提案、人事考課における賃金決定、離職予測やエンゲージメントの向上など、幅広い場面での活用が想定されます。採用や離職防止のためのシステムが製品ベースとしてすでに実用化されています。

AIを人事管理に用いる場合の注意点の一つは、先ほどから述べているとおり、公平性の保証です。データや特徴量にバイアスが入る可能性は否定できません。二つ目は、深層学習では説明性が困難であること。三つ目は、外れ値や未知のデータに弱いことがあります。

労働法という観点では、差別の問題があります。性別や障害、国籍などを理由とした直接差別が禁止されているのはもちろん、男女雇用機会均等法などでは間接差別も禁止されています。これらに抵触するような差別的な要素(性別や身長など)を学習用データから除外する必要があります。

また、AIの判定に対する責任の問題もあります。例えば、AIの判定に対して労働者が不服を申し立てた場合、使用者の責任はどうあるべきでしょうか。製品の開発やデータの選定に使用者がかかわっていることを踏まえると、使用者には説明責任が生じ得ると考えられます。

代替されやすい業務とは

AIがこれまであった業務を代替する可能性も踏まえなければいけません。代替されやすい業務は、業務の手順や判断基準を基準化しやすい業務です。例えば、コールセンターでの問い合わせ対応や、倉庫作業は代替が進みやすいといえます。こうした業務は、AIの精度が向上し業務に使えるレベルになった段階から代替が進むと考えられます。また、高炉制御のような熟練工の暗黙知に頼っていた業務でもAIを使う動きが進んでいます。営業については、提案や見積もりなどの個別の作業はAIで代替可能であるものの、各作業をつなぐ調整業務は、現状では人間が担った方がコストが安く済みます。

労働のAIによる代替の事例を考えてみます。労働のAIによる代替は、業務の一部をAIに行わせる「補助型」から、業務の主軸をAIが担い、人間がそれを管理する「管理型」、基本的にすべての業務をAIが行い人間はメンテナンスのみを行う「自律型」へと進化するのではないかと考えられます。

このような変化が起きた場合、問題となるのは業務転換や整理解雇です。

AIの導入に伴い整理解雇を行わなければいけない場合でも、整理解雇の4要件を満たす必要があります。例えば、解雇を回避するために再教育によりAI人材を育成したり、AIにはできない業務に配置転換したりする必要がありますし、被解雇者の選定にあたってはAIに任せるのではなく、最終的には人間が判断する必要などが出てくるでしょう。

個人情報保護や関連法規

個人情報などに関する注意も必要です。データ収集時には、個人情報保護法やプライバシーに配慮しなければいけません。

EUは、2016年に「EU一般データ保護規則(GDPR)」を策定し、人間が自動処理のみによる重大な決定の対象にされない権利を明記しました。また、2021年4月に提案した「AI規則案」の中では、採用・昇進・契約関係の終了などの決定に用いられるAIを「ハイリスクAI」に分類・規制しています。

一方、日本は、政府によるガイドラインづくりが進んでいるものの、法的拘束力のあるルールは今のところ整備されていません。

労働組合としてもAIに関してある程度専門的な知識を持ち、対応する必要があります。例えば、会社が導入しようとしているAIシステムが、機械学習(深層学習を除く)、深層学習のどれを用いているのか。製品を用いる場合にどのようなデータを用いるのか、特徴量をどう設定するのか、どんなデータを分析するのかなど、会社に確認することが求められます。専門家の協力を得ながら、AIについて学んでほしいと思います。

![情報労連[情報産業労働組合連合会]](/common/images/logo_ictj.png)